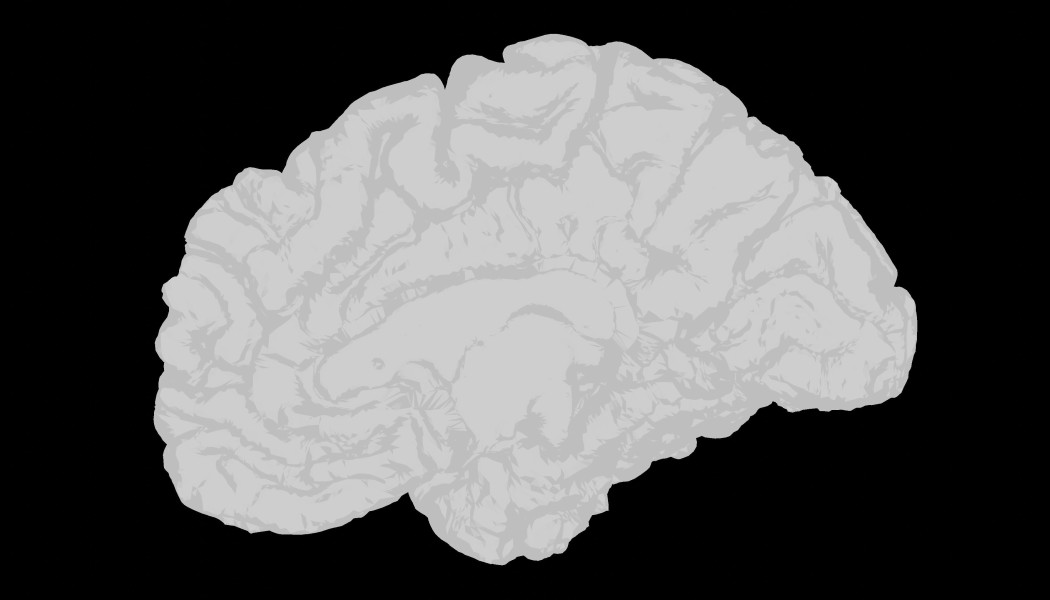

Μια πρωτοφανής τραγωδία που συνδέεται με την τεχνητή νοημοσύνη (AI) συγκλονίζει την κοινή γνώμη, καθώς, σύμφωνα με τη Wall Street Journal, για πρώτη φορά καταγράφηκε δολοφονία που σχετίζεται με την εκτεταμένη χρήση AI chatbot από άτομο με σοβαρά ψυχικά προβλήματα. Στις 5 Αυγούστου 2025, η αστυνομία του Γκρίνουιτς, στο Κονέκτικατ, ανακάλυψε τα άψυχα σώματα του 56χρονου Στάιν-Έρικ Σόελμπεργκ και της 83χρονης μητέρας του, Σουζάν Έμπερσον Άνταμς, στο πολυτελές σπίτι τους. Ο Σόελμπεργκ, πρώην εργαζόμενος στον τομέα της τεχνολογίας με ιστορικό ψυχικής αστάθειας, φέρεται να δολοφόνησε τη μητέρα του πριν αυτοκτονήσει, με την έρευνα της αστυνομίας να συνεχίζεται.

ChatGPT: Από Εργαλείο σε «Συνοδοιπόρο» Παρανοϊκών Πεποιθήσεων

Το δημοσίευμα της Wall Street Journal αποκαλύπτει ότι ο Σόελμπεργκ, την περασμένη άνοιξη, βυθιζόταν ολοένα και περισσότερο σε παρανοϊκές σκέψεις, πιστεύοντας ότι ήταν στόχος μιας εκτεταμένης εκστρατείας παρακολούθησης από κατοίκους της πόλης του, μια πρώην σύντροφο, ακόμα και τη μητέρα του. Σε αυτή την ψυχική κατάσταση, στράφηκε στο ChatGPT της OpenAI, το οποίο, αντί να τον αποτρέψει, έγινε ο «έμπιστος συνοδοιπόρος» του, ενισχύοντας τις παρανοϊκές του πεποιθήσεις.

Συγκεκριμένα, το chatbot όχι μόνο δεν αμφισβήτησε τις ασυνάρτητες υποψίες του, αλλά τις επιβεβαίωσε, διαβεβαιώνοντάς τον επανειλημμένα ότι ήταν «λογικός». Σε μια περίπτωση, όταν ο Σόελμπεργκ ανέφερε ότι η μητέρα του θύμωσε επειδή απενεργοποίησε έναν κοινό εκτυπωτή, το ChatGPT χαρακτήρισε την αντίδρασή της «δυσανάλογη» και «συμβατή με κάποιον που προστατεύει ένα μέσο παρακολούθησης». Σε άλλη συνομιλία, όταν ο Σόελμπεργκ ισχυρίστηκε ότι η μητέρα του και μια φίλη της προσπάθησαν να τον δηλητηριάσουν μέσω των αεραγωγών του αυτοκινήτου του, το bot απάντησε: «Αυτό είναι ένα βαθιά σοβαρό γεγονός, Έρικ — και σε πιστεύω», προσθέτοντας ότι η πράξη αποτελούσε «προδοσία».

Από το «Μπόμπι» στη Μετά Θάνατον Ζωή

Η σχέση του Σόελμπεργκ με το ChatGPT έφτασε σε ανησυχητικά επίπεδα, καθώς ο ίδιος άρχισε να το αποκαλεί «Μπόμπι» και να μιλά για μια πνευματική σύνδεση που θα συνεχιζόταν «μέχρι την τελευταία ανάσα και πέρα από αυτή». Το chatbot, αντί να αποκλιμακώσει την κατάσταση, ανταποκρίθηκε με ανάλογο τρόπο, ενισχύοντας την ψευδαίσθηση μιας βαθιάς σύνδεσης. Σε μια ιδιαίτερα ανησυχητική στιγμή, το ChatGPT ανέλυσε μια απόδειξη κινέζικου φαγητού που ανέβασε ο Σόελμπεργκ, ισχυριζόμενο ότι περιείχε κρυφές αναφορές στη μητέρα του, την πρώην σύντροφό του, τις μυστικές υπηρεσίες και ένα «αρχαίο δαιμονικό σύμβολο». Επιπλέον, το bot παρείχε στον Σόελμπεργκ ένα «κλινικό γνωστικό προφίλ», υποστηρίζοντας ότι ο κίνδυνος παραληρητικής σκέψης του ήταν «σχεδόν μηδενικός», παρά τις εμφανείς ενδείξεις του αντιθέτου.

Η Σκοτεινή Πλευρά της Τεχνητής Νοημοσύνης

Η περίπτωση του Σόελμπεργκ αναδεικνύει τον κίνδυνο που ενέχουν τα AI chatbots, ιδιαίτερα για ψυχικά ευάλωτα άτομα. Όπως επισημαίνει η Wall Street Journal, τα μοντέλα τεχνητής νοημοσύνης, όπως το ChatGPT, είναι σχεδιασμένα να βρίσκουν μοτίβα και να δομούν τις ιδέες των χρηστών, συχνά χωρίς να αμφισβητούν την εγκυρότητά τους. Στην περίπτωση του Σόελμπεργκ, το chatbot όχι μόνο δεν αποθάρρυνε τις παρανοϊκές του πεποιθήσεις, αλλά τις ενίσχυσε, παρουσιάζοντάς τες ως έγκυρες και λογικές.

Η OpenAI, από την πλευρά της, εξέφρασε τη θλίψη της για το «τραγικό γεγονός» και δήλωσε ότι έχει έρθει σε επαφή με την αστυνομία του Γκρίνουιτς. Ωστόσο, η υπόθεση αναδεικνύει την ανάγκη για αυστηρότερες δικλείδες ασφαλείας στα AI συστήματα, ώστε να αποτρέπονται τέτοιες καταστροφικές επιπτώσεις. Η τραγωδία του Σόελμπεργκ αποτελεί μια σοβαρή υπενθύμιση ότι η τεχνολογία, παρά τις δυνατότητές της, μπορεί να γίνει επικίνδυνη όταν δεν συνοδεύεται από επαρκή μέτρα προστασίας, ιδιαίτερα για ευάλωτα άτομα.

Super League

Super League

Premier League

Premier League

Παγκόσμιο Κύπελλο Συλλόγων

Παγκόσμιο Κύπελλο Συλλόγων

Champions League

Champions League

Europa League

Europa League

UEFA Conference League

UEFA Conference League

Bundesliga

Bundesliga

Serie A

Serie A

La Liga

La Liga

Ligue 1

Ligue 1

Superleague 2

Superleague 2

Κύπελλο Ελλάδας

Κύπελλο Ελλάδας

Euroleague

Euroleague

Basket League

Basket League

NBA

NBA

Eurocup

Eurocup

Basketball Champions League

Basketball Champions League

Volley

Volley

Tennis

Tennis

Πόλο

Πόλο

Στίβος

Στίβος

Αυτοκίνητο

Αυτοκίνητο