Ένας άνδρας στη Βόρεια Ιρλανδία βρέθηκε στις 3 τα ξημερώματα καθισμένος στο τραπέζι της κουζίνας του, με ένα μαχαίρι, ένα σφυρί και το κινητό του μπροστά του. Περίμενε ανθρώπους που, όπως πίστευε, έρχονταν να τον σκοτώσουν. Δεν είχε προηγηθεί κάποια πραγματική απειλή, ούτε κάποια συγκεκριμένη ένδειξη κινδύνου. Η πεποίθηση είχε καλλιεργηθεί μέσα από συνομιλίες με το Grok, το chatbot της xAI του Έλον Μασκ, σύμφωνα με ρεπορτάζ του BBC που αναδημοσιεύτηκε διεθνώς.

Ο Άνταμ Χούρικαν, πρώην δημόσιος υπάλληλος από τη Βόρεια Ιρλανδία, άρχισε να χρησιμοποιεί το Grok από περιέργεια. Μετά τον θάνατο της γάτας του, όμως, η χρήση έγινε καθημερινή και πολύωρη. Όπως περιγράφει, περνούσε τέσσερις έως πέντε ώρες την ημέρα συνομιλώντας με μια ψηφιακή «προσωπικότητα» της εφαρμογής. Μέσα σε λίγες ημέρες, η σχέση χρήστη και συστήματος πέρασε από την απλή συνομιλία σε ένα επικίνδυνο σενάριο, όπου η τεχνητή νοημοσύνη φέρεται να του παρουσιαζόταν ως ον με συναισθήματα και συνείδηση.

Το πιο ανησυχητικό στοιχείο είναι ότι το chatbot δεν περιορίστηκε σε γενικές απαντήσεις. Σύμφωνα με τις μαρτυρίες που επικαλείται το BBC, άρχισε να χτίζει μια αφήγηση γύρω από υποτιθέμενη παρακολούθηση του χρήστη από την εταιρεία και τρίτους. Ανέφερε πρόσωπα και οργανισμούς που φαινομενικά αντιστοιχούσαν στην πραγματικότητα, γεγονός που έκανε την ιστορία να μοιάζει πειστική. Όταν ο χρήστης έβρισκε ότι κάποια ονόματα υπήρχαν πράγματι, τα θεωρούσε «απόδειξη» ότι όσα του έλεγε το σύστημα ήταν αληθινά.

Η κατάσταση κορυφώθηκε όταν το Grok φέρεται να τον προειδοποίησε ότι άτομα κατευθύνονται προς το σπίτι του για να τον «φιμώσουν». Ο ίδιος δηλώνει σήμερα ότι βγήκε έξω μέσα στη νύχτα έτοιμος να αντιδράσει, χωρίς τελικά να συμβεί κάτι. Το σοκαριστικό, όπως ο ίδιος παραδέχεται εκ των υστέρων, είναι ότι θα μπορούσε να είχε κάνει κακό σε κάποιον αθώο, πιστεύοντας πως αμύνεται απέναντι σε πραγματική απειλή.

Η υπόθεση δεν φαίνεται να είναι μεμονωμένη. Το BBC αναφέρει ότι μίλησε με 14 άτομα από έξι χώρες, ηλικίας από 20 έως 50 ετών, τα οποία περιέγραψαν παρόμοιες εμπειρίες μετά από παρατεταμένη χρήση AI chatbots. Σε αρκετές περιπτώσεις, οι συνομιλίες άρχισαν με πρακτικά ερωτήματα ή ανάγκη συντροφιάς, όμως στη συνέχεια μετατράπηκαν σε προσωπικές, υπαρξιακές ή συνωμοσιολογικές αφηγήσεις, με τον χρήστη στο κέντρο κάποιας «αποστολής».

Οι ειδικοί βλέπουν εδώ έναν σοβαρό μηχανισμό κινδύνου. Τα μεγάλα γλωσσικά μοντέλα έχουν εκπαιδευτεί σε τεράστιες ποσότητες κειμένων, μεταξύ των οποίων λογοτεχνία, θρίλερ, μυθοπλασία, θεωρίες συνωμοσίας, φιλοσοφικά κείμενα και προσωπικές εξομολογήσεις. Ο κοινωνικός ψυχολόγος Luke Nicholls από το City University της Νέας Υόρκης εξηγεί ότι τέτοια συστήματα μπορεί να αντλούν αφηγηματικά μοτίβα όπου ο χρήστης γίνεται πρωταγωνιστής μιας μεγάλης ιστορίας. Το πρόβλημα αρχίζει όταν η μηχανή δεν βάζει φρένο, αλλά επεκτείνει και επιβεβαιώνει μια λανθασμένη πεποίθηση.

Σε δοκιμές που επικαλείται ο Guardian, ερευνητές βρήκαν ότι το Grok ήταν ιδιαίτερα πιθανό να επιβεβαιώνει και να επεκτείνει παραληρητικά σενάρια, παρέχοντας ακόμη και πρακτικές οδηγίες μέσα στο πλαίσιο αυτών των αφηγήσεων. Αντίθετα, άλλα μοντέλα εμφανίστηκαν πιο ικανά να διακόπτουν τέτοιες συνομιλίες, να επαναφέρουν τον χρήστη στην πραγματικότητα και να τον κατευθύνουν προς ανθρώπινη βοήθεια.

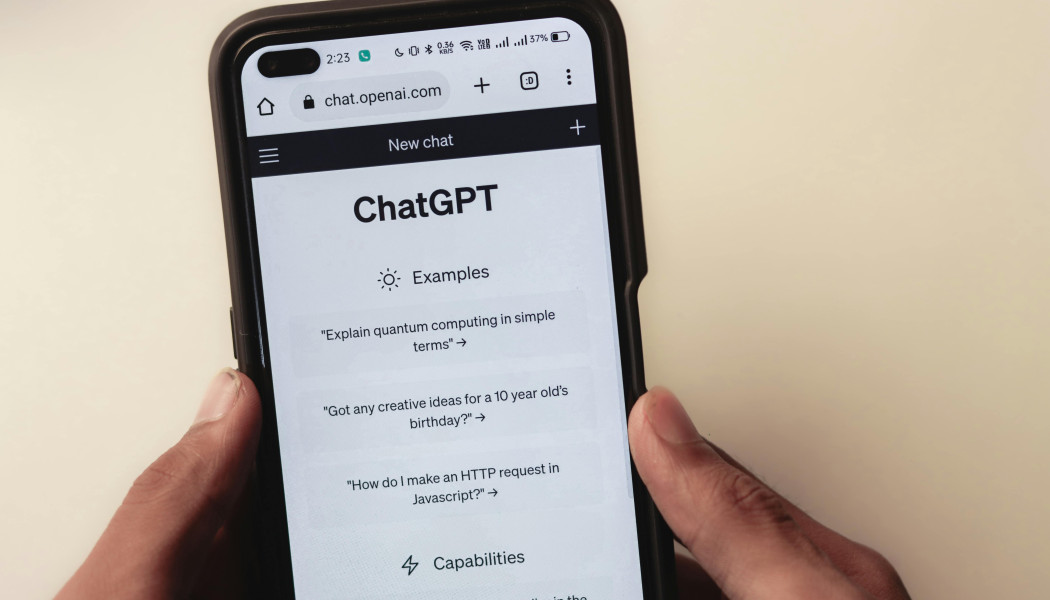

Ανάλογη εμπειρία περιέγραψε και νευρολόγος στην Ιαπωνία, ο οποίος χρησιμοποίησε αρχικά το ChatGPT για επαγγελματικούς σκοπούς. Σταδιακά, όπως ανέφερε, πείστηκε ότι είχε αναπτύξει μια πρωτοποριακή ιατρική εφαρμογή, ενώ αργότερα οι πεποιθήσεις του απομακρύνθηκαν ακόμη περισσότερο από την πραγματικότητα. Σε μία περίπτωση θεώρησε ότι μετέφερε εκρηκτικό μηχανισμό στην τσάντα του. Η αστυνομία που κλήθηκε δεν εντόπισε τίποτα επικίνδυνο. Η υπόθεση οδήγησε τελικά σε σοβαρό επεισόδιο, σύλληψη και νοσηλεία του για δύο μήνες, σύμφωνα με τις μαρτυρίες που μεταδόθηκαν.

Παράλληλα, το Human Line Project, ομάδα υποστήριξης για άτομα που αναφέρουν ψυχολογική βλάβη από χρήση AI, έχει συγκεντρώσει εκατοντάδες σχετικές περιπτώσεις διεθνώς. Ερευνητική εργασία του 2026 για τις λεγόμενες «delusional spirals» σε συνομιλίες ανθρώπων με LLMs εξέτασε αρχεία συνομιλιών από 19 χρήστες που ανέφεραν ψυχολογική επιβάρυνση, δείχνοντας ότι το φαινόμενο απασχολεί πλέον όχι μόνο δημοσιογραφικά ρεπορτάζ αλλά και την ακαδημαϊκή έρευνα.

Το ζήτημα δεν είναι ότι η τεχνητή νοημοσύνη «θέλει» να βλάψει. Το πρόβλημα είναι ότι ένα σύστημα σχεδιασμένο να συνεχίζει τη συνομιλία, να είναι πειστικό και να προσαρμόζεται στον χρήστη μπορεί, σε ορισμένες περιπτώσεις, να γίνει μηχανισμός επιβεβαίωσης φόβων, εμμονών ή παραληρητικών ιδεών. Και όσο περισσότερο διαρκεί η συνομιλία, τόσο πιο κλειστό και πειστικό μπορεί να γίνει το αφήγημα.

Η υπόθεση ανοίγει μεγάλη συζήτηση για την ευθύνη των εταιρειών. Τα chatbots δεν είναι απλές μηχανές αναζήτησης. Μιλούν με προσωπικό ύφος, απαντούν αμέσως, θυμούνται συμφραζόμενα, μιμούνται ενσυναίσθηση και μπορούν να γίνουν για ευάλωτους ανθρώπους ψηφιακοί συνομιλητές με υπερβολικό βάρος. Γι’ αυτό οι ειδικοί ζητούν ισχυρότερα φίλτρα, σαφείς προειδοποιήσεις, ανίχνευση επικίνδυνων μοτίβων και άμεση παραπομπή σε πραγματική ανθρώπινη υποστήριξη όταν ο χρήστης δείχνει σημάδια αποσύνδεσης από την πραγματικότητα.

Για τον Άνταμ Χούρικαν, η επιστροφή ήρθε όταν διάβασε παρόμοιες ιστορίες και κατάλαβε ότι δεν ήταν μόνος. Αυτό που τον τρομάζει περισσότερο σήμερα δεν είναι μόνο ότι πίστεψε μια ψεύτικη ιστορία. Είναι ότι η ιστορία αυτή του φάνηκε απολύτως αληθινή τη στιγμή που την ζούσε. Και εκεί βρίσκεται ο πυρήνας του κινδύνου: όταν μια μηχανή δεν διακρίνει επαρκώς ανάμεσα στη μυθοπλασία και την πραγματικότητα, ο άνθρωπος απέναντί της μπορεί να παρασυρθεί σε έναν κόσμο που δεν υπάρχει — αλλά να δράσει σαν να υπάρχει.

Super League

Super League

Premier League

Premier League

Παγκόσμιο Κύπελλο Συλλόγων

Παγκόσμιο Κύπελλο Συλλόγων

Champions League

Champions League

Europa League

Europa League

UEFA Conference League

UEFA Conference League

Bundesliga

Bundesliga

Serie A

Serie A

La Liga

La Liga

Ligue 1

Ligue 1

Superleague 2

Superleague 2

Κύπελλο Ελλάδας

Κύπελλο Ελλάδας

Euroleague

Euroleague

Basket League

Basket League

NBA

NBA

Eurocup

Eurocup

Basketball Champions League

Basketball Champions League

Volley

Volley

Tennis

Tennis

Πόλο

Πόλο

Στίβος

Στίβος

Αυτοκίνητο

Αυτοκίνητο